近年、ChatGPTなどの生成AIが急速に普及し、業務効率化やナレッジ活用に期待が高まっています。しかし、生成AI単体では「正確性」や「信頼性」に課題があり、実務での活用には限界があるという声も聞かれます。そこで注目されているのが「RAG(Retrieval-Augmented Generation/検索拡張生成)」という技術です。

本記事では、RAGの仕組みや導入メリット、具体的な活用事例を交えながら、企業が生成AIを安全かつ効果的に活用するためのヒントを詳しくご紹介します。

RAGとは何か?

RAGとは「Retrieval-Augmented Generation」の略で、日本語では「検索拡張生成」と訳されます。これは、生成AIに外部データをリアルタイムで検索・参照させることで、より正確で信頼性の高い回答を導き出す仕組みです。

従来の生成AIは、大規模言語モデル(LLM)に学習された知識の範囲内で文章を生成します。そのため、モデルの学習データに含まれていない最新情報や専門的な自社データには対応できません。また、「ハルシネーション(事実ではない情報をもっともらしく生成する現象)」のリスクもあります。

RAGはこの課題を克服するために、以下の2つのステップで動作します。

- 検索フェーズ(Retrieval):

質問に関連する外部データ(企業内文書、FAQ、マニュアル、Webサイトなど)を検索して取得。 - 生成フェーズ(Generation):

取得した情報を元に、生成AIが回答文を作成。

この仕組みにより、モデルにあらかじめ学習させていない情報でも即座に取り込むことができます。最新かつ正確な回答を提示できるようになります。

従来型のLLMは一般知識には強いものの、企業固有の情報や最新情報への対応には限界がありました。RAGはこの課題を解決し、より現実的かつ業務に直結するAI活用を可能にします。

RAG導入のメリット

メリット1:社内データの有効活用

RAGは自社が保有する社内文書やナレッジベースと連携することで、生成AIに独自情報を参照させることが可能です。これにより、属人化していた情報共有や業務ナレッジの可視化が進みます。

メリット2:業務効率の向上

FAQ対応や社内問い合わせ対応にRAGを活用することで、担当者の負担が軽減されます。とくに問い合わせ件数が多いカスタマーサポート部門や人事・総務部門で大きな効果が期待されています。

メリット3:ハルシネーションの抑制

RAGは外部情報を参照しながら文章を生成するため、従来型の生成AIと比べてでたらめな回答が減少します。事実ベースで正確な情報提供が可能になる点は大きな利点です。

メリット4:常に最新情報を反映可能

検索対象となるデータを定期的に更新することで、モデル自体を再学習しなくても最新情報を反映させることができます。これにより運用コストも抑えられます。

業務設計で考えるべきRAG活用の視点

RAGを導入する際は、業務プロセスの理解と、RAGの構成要素の理解が重要になります。

業務プロセス全体を俯瞰し、「どこで」「誰が」「何のために」情報を必要とするかを明確化します。その上で、FAQ対応・社内ナレッジ検索・レポート自動化などへの応用が可能となります。

また、RAGは以下のような構成要素で構築されています。

- クエリエンジン:

ユーザーからの質問を処理し、意味解析(ベクトル化)を行う。 - ベクトル検索エンジン:

意味的に類似した情報を高精度で検索する。 - ドキュメントストア:

社内文書やWebページなど検索対象となるコンテンツを格納する。 - 大規模言語モデル(LLM):

検索結果を基に文章を生成する。 - UI:チャットボット等のユーザーとのインターフェース。

導入時には以下のポイントにも注意が必要です。

- データ整備:

検索対象となる文書は構造化されている必要があります。PDFやHTMLなど多様なフォーマットへの対応も求められます。 - セキュリティ対策:

社内情報を扱う場合はアクセス制御や暗号化が重要です。 - ユーザビリティ:

現場スタッフが使いやすいUI設計や検索精度向上も重要です。

RAG活用事例

ケース①:130万件の社内文書を横断検索(三井住友銀行(SMBC))

行内のあらゆる「規定・マニュアル・通達」をAIが学習し、即座に回答します。

独自ツール「SMBC-GAI」にRAG機能を搭載。約130万件のファイルをインデックス化し、回答の根拠となる参照元も明示します。

膨大な社内文書を検索する手間を削減し、回答の正確性とスピードが向上しました。

- 社内向け汎用型 AI アシスタントツール「SMBC-GAI」へのRAG 技術を活用した社内情報検索機能の導入について(PDF). 三井住友フィナンシャルグループ. (参照 2026-03-03)

ケース②:「AIチャット案件検索」で直感的なマッチング(レバテック)

ITエンジニア・クリエイター専門のエージェント「レバテック」は、膨大な案件データベースからAIが最適な案件を提案するチャット機能をリリースしました。

「週3日、リモート、報酬80万」といった曖昧な要望をAIが解析し、RAGによってDBから最適な案件を抽出します。複数の条件を一度に処理できるのが強みです。

- レバテックフリーランス、会話形式で希望案件を探せる「AIチャット案件検索(β版)」を提供開始. レバテック. (参照 2026-03-03)

ケース③:障害者福祉サービスへのRAG導入(京都市)

複雑な制度内容をAIに学習させ、事業者や住民からの専門的な問い合わせに対して、回答の根拠(出典)を示しながら自動応答するRAGの代表例です。

- 京都市:「COCO・てらすAIチャットボット」専用ページ. 京都市情報館. (参照 2026-03-03)

ケース④:RAG活用による次世代サイト内検索チャットボット(Business Architects)

従来のサイト検索は、キーワードが完全一致しないと情報に辿り着けない点が課題でした。この解決策として、情報の「意味」を理解するRAG技術を用いたチャットボットを導入。ユーザーの曖昧な質問に対しても、サイト内から関連性の高い情報を瞬時に特定し、要約して回答します。必要なページを探し回る手間を省き、24時間稼働のコンシェルジュのような体験を提供することで、顧客満足度の向上と離脱防止を実現します。

- Business Architects - ビジネス・アーキテクツ. (参照 2026-03-03)

導入ステップと進め方

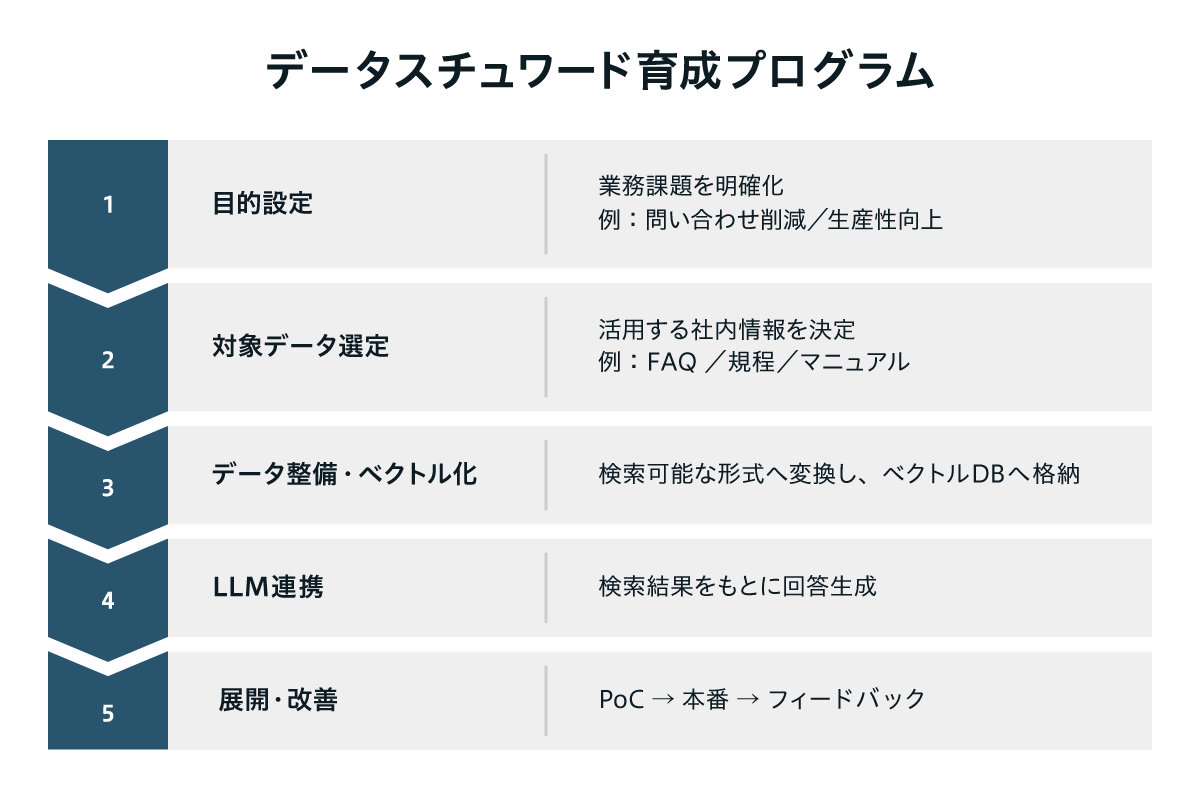

RAG導入にあたっては、以下の5ステップで進めることが一般的です。

①目的設定

「どんな課題を解決したいか」を明確化する。

例:社内問い合わせの削減、生産性向上など。

②対象データ選定

活用する社内データを選定する。

例:FAQ、社内規程集、業務マニュアルなど。

③データ整備・ベクトル化

選定したデータをAIが理解できる形式(ベクトル)に変換し、検索可能なデータベースに格納する。

例:PDFやWordを分割・数値化し、意味の近さで検索できる状態にする。

④LLM連携

OpenAI GPT-4やClaudeなどのLLMと連携し、検索結果を元に自然な応答を生成する。

⑤展開・改善

PoCで効果検証後、本番環境へ展開し、ユーザーからのフィードバックを元に改善サイクルを回す。

成功へのポイント:失敗しないための注意点

データ品質が最重要

ノイズ混在や古い文書は誤回答の原因になります。構造化・正規化・最新化されたドキュメント整備が鍵です。

LLM選定とカスタマイズ戦略

オープンソースLLMも含めた選定、およびプロンプトエンジニアリングによる応答精度チューニングも重要です。

ユーザー体験を重視したUI設計

業務担当者が直感的に使えるインターフェースは導入定着率に直結します。

RAG導入を成功させるための「4つの分かれ道」

技術的な手順は決まっていても、実際の現場では「どっちの方向に進むか?」で判断が分かれます。この判断がプロジェクトの成否を握ります。

- 「どこまでAIに任せるか」の分かれ道

「資料をパッと探してほしい」だけなのか、「資料を読み込んで判断までしてほしい」のかで、要求される信頼度で設計難易度が大きく変わります。

役割が広がるほど、AIが嘘をついた(ハルシネーション)時のリスク管理が難しくなります。 - 「データの整理にどこまで手間をかけるか」の分かれ道

今あるPDFをそのまま読み込ませるか、AIが読みやすいように綺麗に作りなおすか。

手を抜くと検索精度が下がり、丁寧にやりすぎると準備だけで数か月過ぎてしまいます。 - 「コストと安心感」の分かれ道

最新の高性能なAIをクラウドで使うか、セキュリティを重視して自社専用の環境をガチガチに固めるか。

性能が良いものは高価、あるいは社内規定に触れる。この「予算とルール」のバランス取りがもっとも揉めるポイントです。 - 「誰が育てていくか」の分かれ道

作るところまでをゴールにするか、作った後に「回答がイマイチ」と言われた時のメンテナンスまで含めるか。

導入後に現場から届く「もっとこうしてほしい!」という要望に応え続ける体制がないと、次第に使われなくなってしまいます。

これらは社内の状況によって正解が一つとは限らないため、業務内容や体制を踏まえた設計判断が重要になります。

RAG導入による課題と今後の展望

課題①:初期構築コストと専門知識

RAG導入にはベクトル検索エンジンやドキュメント整備など一定の技術的ハードルがあります。適切なパートナー選定やPoC(実証実験)からはじめることが推奨されます。

課題②:データ品質への依存性

RAGの精度は参照対象となるデータ品質に大きく依存します。文書構成が不明瞭だったり冗長すぎたりすると誤った回答につながるため、事前のデータ整備が欠かせません。

展望:専門領域への拡張と自動学習型RAGへ

「自己進化型RAG」は、AI自身が検索や回答の質を評価・修正し、自律的に賢くなる次世代のRAG(検索拡張生成)技術の概念を指します。

これは特定の単一モデルではなく、既存のRAGアーキテクチャの進化形として登場した「Self-RAG(自己反省型RAG)」や「Agentic RAG(エージェント型RAG)」といった最新技術の総称的な表現といえます。

まとめ:RAGは業務知能化への第一歩

RAGは単なる技術トレンドではなく、「企業知」をAIで再活用するための革新的アプローチです。業務効率化だけでなく、属人化排除やナレッジ資産化によって組織全体の生産性と柔軟性を高める可能性があります。

PoCから本導入へ進めるためには、明確な目的設定と段階的なアプローチが欠かせません。ただし、こうしたプロセスを踏むことで、中長期的には高いROIが見込める分野でもあります。

まずは小さく試し、成果を可視化しながら、全社展開へとつなげていくことが成功への鍵となるでしょう。

RAG導入を成功させるためには、技術そのもの以上に

「どの業務に適用するのか」

「どこまでを自動化するのか」

「どの構成が自社に合うのか」

といった設計・判断の精度が成果を大きく左右します。

Business Architects(ビジネス・アーキテクツ)では、RAGやDifyといったツールありきではなく、業務整理・目的設計から伴走し、小さく試しながら本番活用へつなげる導入支援を行っています。

「自社の場合、どこからはじめるべきか」を整理したい段階でも構いませんので、ぜひ一度ご相談ください。